新闻资讯

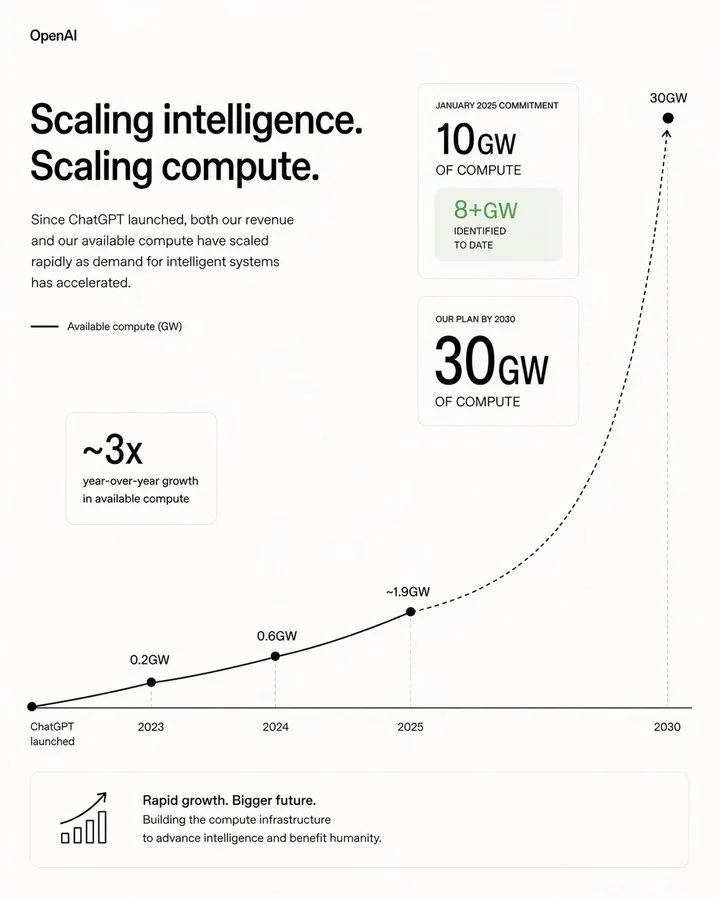

OpenAI锁定超8GW算力资源,巨额开支成负担

30GW。主要以租赁服务形式取得算力,但每年的云服务开支对其来说也将是一笔沉重的负担。

声称人工智能的公司正在不顾一切地疯狂抢夺算力资源,这家特定的企业当下已经锁定了超出8GW 的算力规模,距离年初所确定的10GW目标仅仅只差那么一小步。然而每构建1GW数据中心就需要耗费掉数百亿美元,这笔巨额资金究竟从什么地方来实在是一个重大的问题。

8GW算力已经逼近目标

4月22日时,官方宣称,公司所锁定的总功率算力资源,已然突破了8GW这个大关,此数字与2025年初所设定的10GW目标相比,仅仅只剩下不到2GW的差距,公司高层针对这一进展,表达了满意之情。

依据当下的速度来进行推算,在今年的第三季度,便能够达成10GW的阶段性目标。直至2030年的时候,这家公司计划要把算力规模扩展至30GW,这等同于现存规模的将近四倍。这种扩张速度在行业范围之内属于第一梯队。

建数据中心到底有多贵

构建规模为1GW的AI数据中心,在前期之时投入起码得需要数百亿美元,这些资金主要是用以购置GPU芯片、搭建冷却系统、铺设电力设施以及购买土地,按照当下的市场价格来计算,仅仅是NVIDIA的H100芯片就会占据一半的预算。

有一个天文数字是30GW的总投资额,这家公司当前市场估值在8000亿美元以上,建设30GW数据中心的总花费至少等同于当前估值,甚至有可能达到估值的两倍,这就意味着公司得拿出1.6万亿美元去建这些设施。

租赁模式带来财务压力

此家公司获取算力主要借助租赁服务形式,并非自己购入土地去建造数据中心。这种模式具备的好处是,前期无需投入巨额资本,能够迅速扩充算力规模。众多AI创业公司运用这样的方式来降低初期成本。

但租赁模式可不是没有颇为显著的短处,每一年都得去支付的云服务费用,那可是一项沉甸甸的负担,随着计算能力规模扩充到30GW ,这笔按年度来算的支出会高得令人惧怕。相比较而言,自己建造数据中心虽说在刚开始的时候投入挺大,可从长远来看运营成本反倒会更低。

电力供应成为新瓶颈

大规模算力中心所最为欠缺的并非芯片,而是供电稳定的电力。8GW的算力已然等同于8个大型核电站的发电总量,这表明得有专门予以配套的电网。当下全球能够供应这般规模电力的地区少之又少。

满足2030年30GW的电力需求会更为困难,公司需同多个国家的电力公司签订长期供电协议,还要建设专用的变电站以及输电线路,一些分析师指明,北美和北欧的电力基础设施或许无法跟上这种扩张速度。

竞争对手也在抢资源

不仅是这家公司在争抢算力,微软、谷歌、亚马逊这些属于科技巨头范畴的厂商也在极度疯狂地进行数据中心的大规模扩建。微软拟定计划到2026年把算力提升至15GW,谷歌所设定的目标是12GW。所有人都在对有限的电力资源以及芯片供应展开激烈争夺。

直接推高成本的是这种竞争,2024年时,一台H100服务器的租赁价格相较于2023年上涨了40%,高端GPU的交付周期延长至一年以上,就连冷却系统所使用的工业风扇都出现缺货的情况,整个供应链处于紧绷状态。

未来三年是关键窗口期

2026年底前,公司得完成10GW目标,不然会失掉市场信心。当下已签约的8GW算力里,3GW源自北美地区的数据中心,2GW来自北欧,剩下的分布于东南亚与澳大利亚。未来18个月内,这些数据中心会陆续上线。

2030年要达成的30GW计划能不能实现,这得看未来三年现金流处于何种状况。要是AI应用的市场需求每年增速维持在50%以上,那么收入可以覆盖租赁成本。然而要是增速变缓,数额巨大的租金开支会成为致使公司垮掉的最后关键因素。

难道你认为这家公司是应当持续租赁算力呢,还是要自己建造数据中心以此来削减成本呢?欢迎于评论区去分享你的观点,点赞数量超过1000的话我会接着剖析其他AI公司的算力策略?