新闻资讯

Steam调整AI披露机制:明确两类AI使用情况及开发者责任

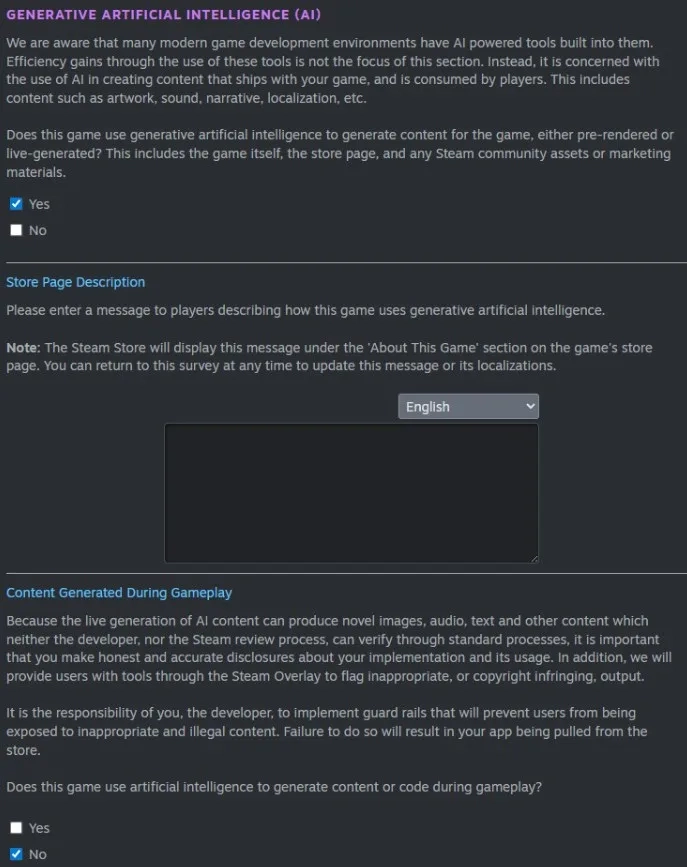

披露机制进行了调整,进一步明确哪些人工智能使用情况需要向玩家公开说明。工具(注:辅助编程或自动化开发软件等)。新的披露规则主要涵盖两类情形。的具体用途,并可根据情况进行更新。要求开发者在设计阶段就配套完善的安全与控制措施。生成内容不被玩家接触,是开发者的直接责任。有权将从平台移除游戏。

Steam平台展开了对AI内容披露规则的调整,这一调整直接有着关系,关乎到玩家知情权,以及开发商创作自由的平衡。

游戏内容透明度提升

Valve作出明确要求,所有游戏于商店页面都得披露玩家能够接触到的AI生成内容,这就意味着玩家在进行购买之前便能够清晰了解游戏的美术、音效或者剧情是不是由AI辅助生成的,这项规定涵盖了从游戏本体直至营销素材的所有公开内容。

在“关于本游戏”栏目里,开发商得详细说明 AI 的具体应用场景,像某个角色设计运用了 AI 绘画工具,或者某些对话文本是由语言模型生成的,这些信息都要明确告知消费者,这一变化能让玩家依据自身偏好做出更明智的选择。

开发流程工具获豁免

Steam新规特意不包括开发进程里所运用的效率类型 AI 工具,编程辅助软件、自动化测试工具等后台技术无需作特别披露,Valve觉得这些工具不会对最终游戏体验产生影响。

这一决定使得开发者的申报负担得以减轻,众多团队于日常工作期间会运用GitHub Copilot这类代码生成工具,或者借助AI来进行bug检测,如今他们不用再对玩家就这些内部流程作出说明,能够更专心地致力于创作本身 。

实时生成内容受监管

针对游戏于运行期间动态生成AI相关内容的情形,Valve制订了更为严苛的要求,此种系统有可能在玩家展开互动之际实时生出图像,或者音频,或者对话,具备不可预测的特性。

须由开发商为那种实时AI系统给设计出完备完善的安全措施,像去设定内容过滤器,还要建立人工审核机制,并且设置紧急关闭功能等,这些保障得在游戏设计阶段就融入整合进开发流程,而非事后再去进行补充 。

开发者责任明确化

Valve于更新条款里侧重表明,对AI生成内容予以管理的责任全然归属于开发者自身,该平台向开发商提出要求,务必要保证不会出现违法、侵权或者不当之类的内容,而这也就意味着单单的“技术中立”声明已然是不够的了。

要是一旦AI系统出现问题内容,那么开发商就得承担直接责任,Steam会给出举报渠道,不过首要的预防以及应对义务归开发团队,这样一种立场致使开发商将AI系统的安全设计更加看重 。

违规后果具体化

对于那些在未能好好负责管理 AI 内容方面做得不到位的游戏,Valve 留存保留了将其移除的权利,平台能够依据用户所进行的举报以及凭借自身展开的调查从而采取相应行动,这就意味着那些违反规定的游戏有可能会被从商店当中撤下下架 。

这一明确的后果,使得规定所具备的威慑力得以增加,开发商从中意识到,AI内容管理绝非那种可有可无的选项,对于游戏而言,它是关于能否持续在平台上架的一项关键因素,Valve借助这样的机制来维护平台的内容标准 。

行业影响逐渐显现

全球最大的PC游戏平台Steam,其政策的调整会对整个行业产生影响,其他数字发行平台或许会参照类似标准,自2025年起始,各大平台都在对AI内容政策予以完善。

需要进行工作流程调整来适应新要求的正是游戏开发商,中小团队或许得针对法律以及合规方面加大投入,从长远来考量能实现这类效益,即构造出更为健康的AI游戏开发生态,在保障玩家权益期间起到推动技术创新的作用。

关于Steam新规,你持有怎样的看法,是不是觉得其他游戏平台应当去跟进类似的政策,欢迎于评论区把你的观点分享出来。