新闻资讯

苹果研究团队揭示用户对AI智能体的期望及交互偏好

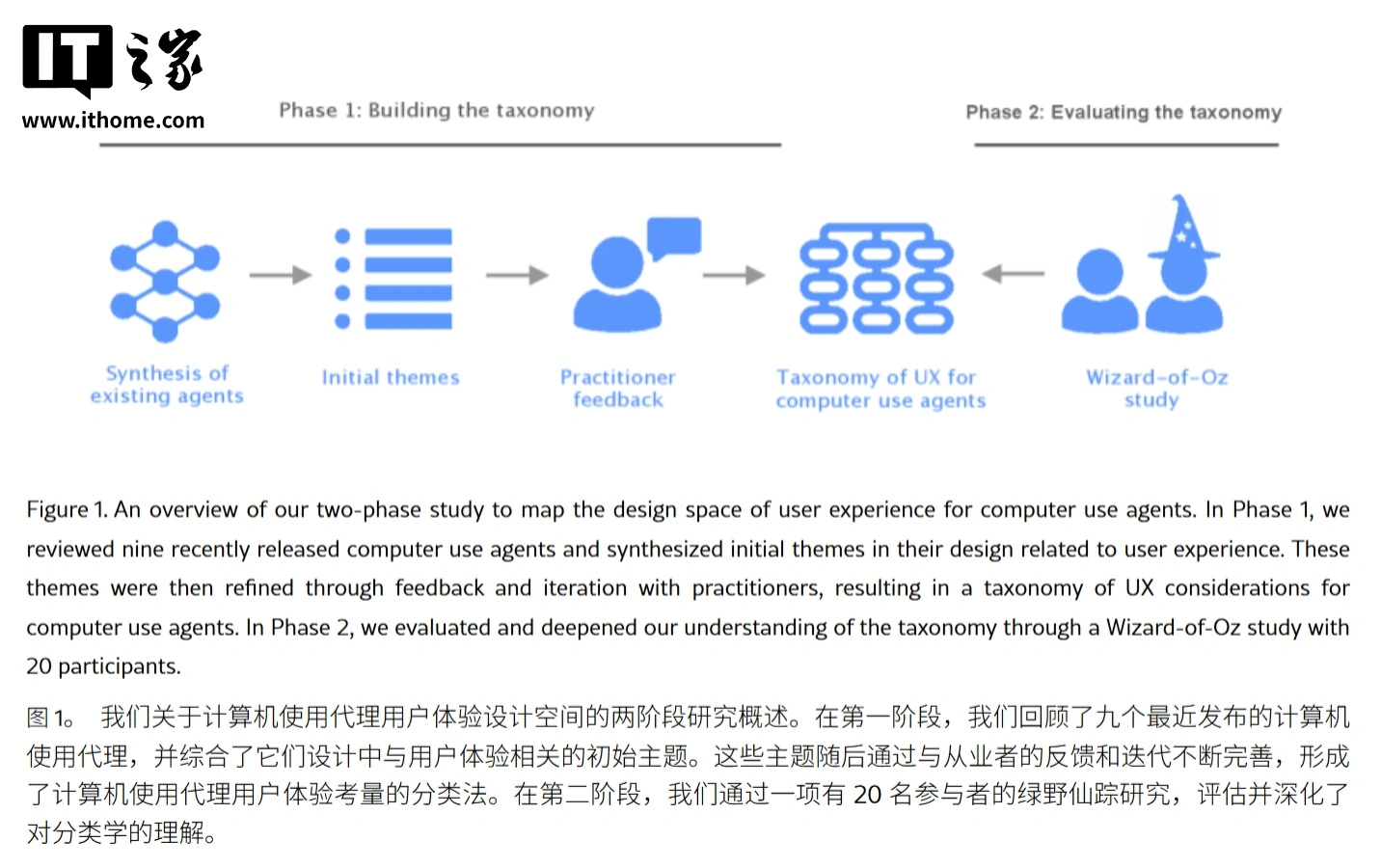

智能体的真实期望及交互偏好。智能体,但关于界面形态及交互逻辑的探索仍显不足。位资深从业者,研究人员构建了一套包含“用户指令”、“活动可解释性”、“用户控制”及“心智模型”四大维度的分类体系。的动向,但拒绝微观管理每一个步骤,否则便失去了使用智能体的意义。

在2月7日发布的一篇关于苹果最新探索内容的学术文章里面,它直接披露透露出了用户针对AI的那种复杂态势的心绪,这件事是值得所有从事研究开发工作的入内行注意观察的,也就是这样的一篇文章给热度很高的AI智能体浇了一瓢冷水,就是说千万别只是一味地专注于技术方面的竞争比拼呀,因为用户真正心里所期望想要达成的,实际上是你能够明确地告知我你当下正在开展的具体活动,并且在关键的时刻还必须得听从我的指令安排呢。

用户到底想要什么样的AI

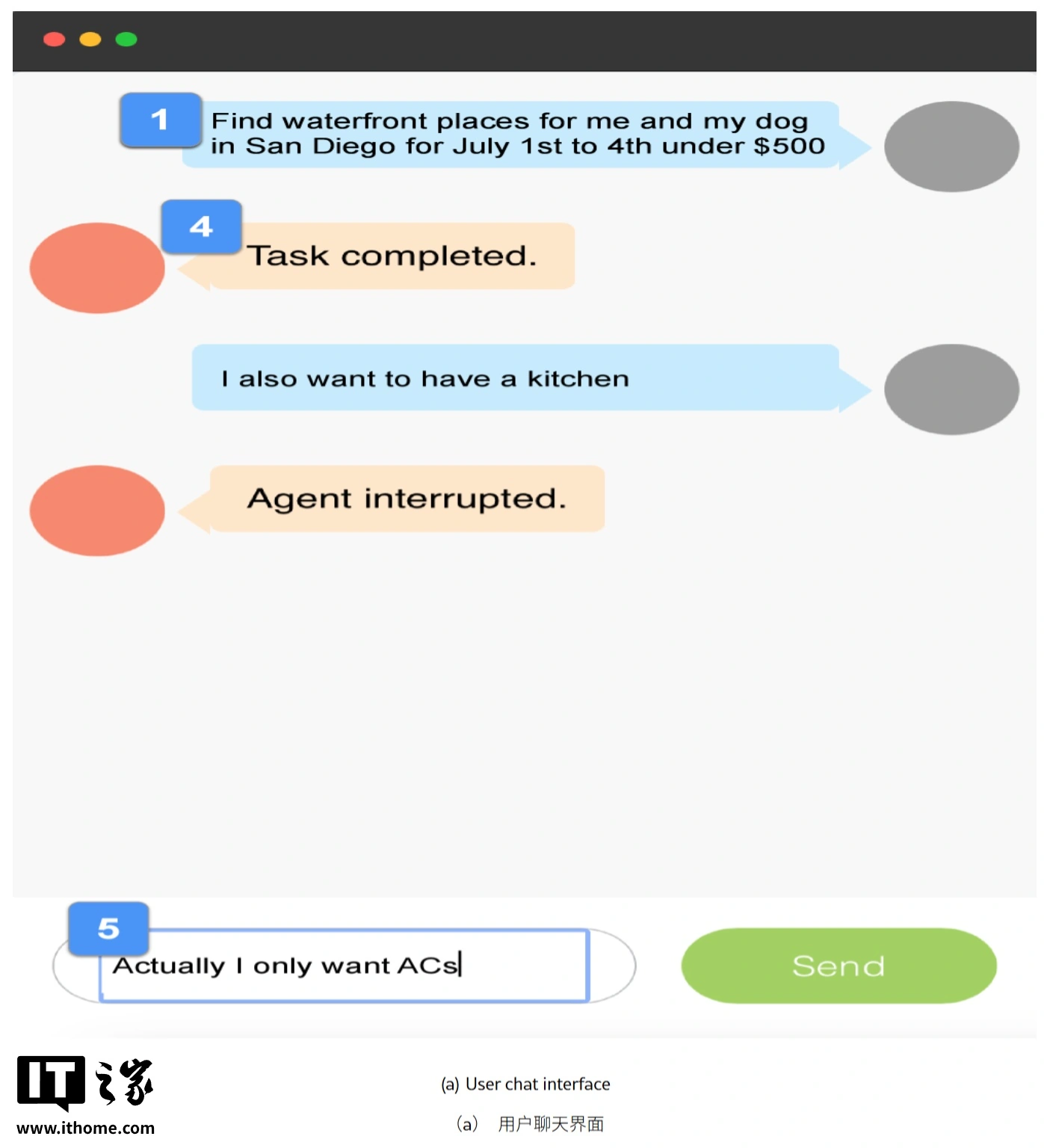

苹果团队找来了20位具备AI使用体验的用户去进行实验,最终得出的结果是,众人对于AI的期待呈现出矛盾的状态,他们一方面期望AI能够自行开展工作,另一方面却不情愿完全撒手不再过问。

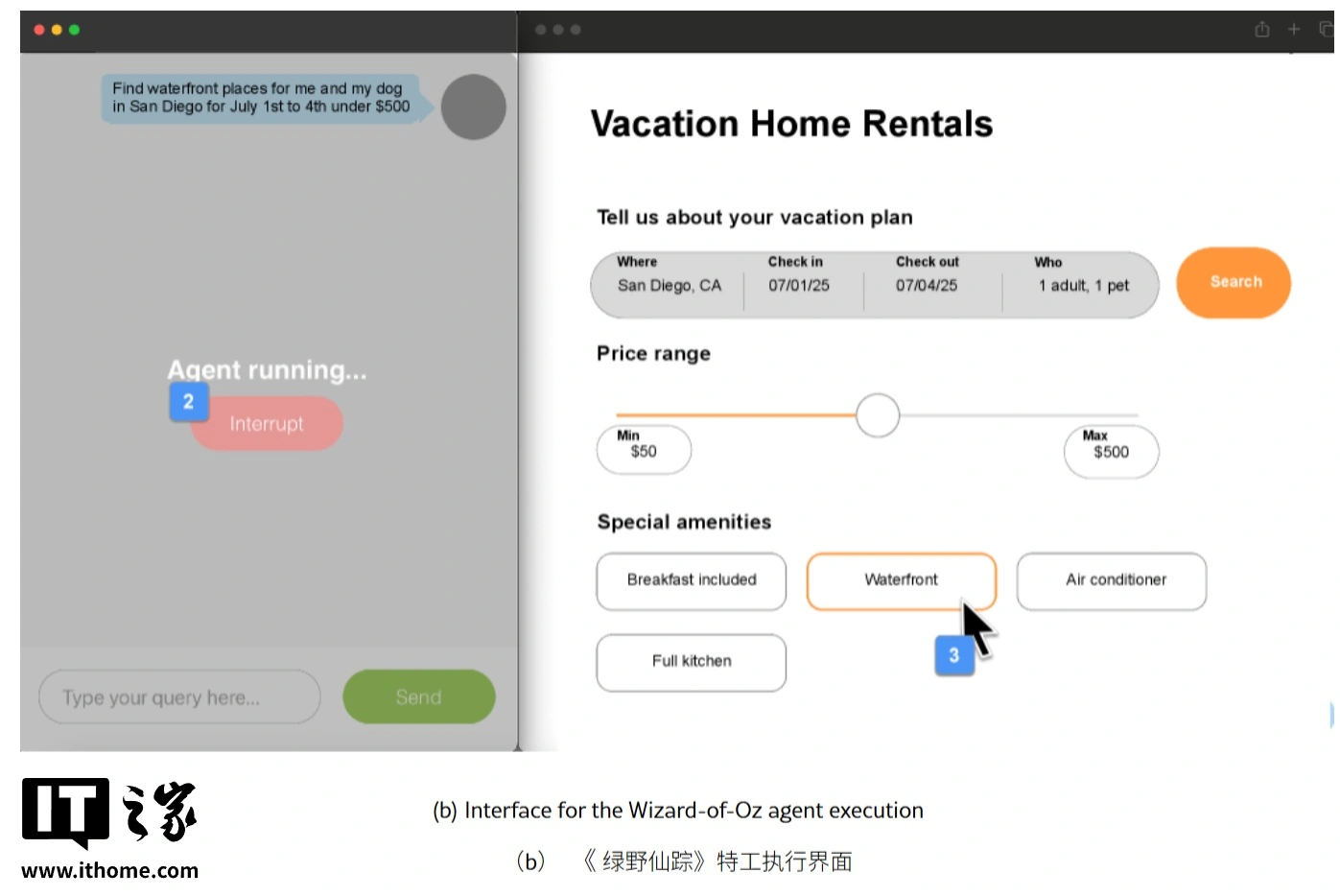

实验当中运用了一种巧妙的办法,使得真人藏在幕后装作AI,如此一来便能够排除技术故障所带来的干扰,进而专门去观察用户在AI出现犯错状况或者卡壳情形时的真实反应。此种方法相当厉害,捕捉到了诸多细节。

透明度是关键但别太过分

用户最为在意之处是透明度,他们企望明确晓得 AI下次会开展怎样的行动。举例而言,当进行度假民宿预订活动时,用户渴盼目睹 AI筛选房源以及对比价格的具体方式。

但具有趣味的是,没有任何人乐意如同看管小孩子那般每一个步骤都紧紧注视着。要是必须持续不断地给人工智能下达命令,那么还比不上自己亲自去动手进行操作来得迅速。这个分寸是非常难以精准把握的。

不同场景要求不一样

于探索性任务之中,像寻觅一处未曾去过的度假之地这般情况,用户反倒期望AI去更多地展现中间步骤。他们想要瞧瞧AI都考量了哪些选项,这能够助力自身做出更为良好的决定。

可当来到高风险环节时,情况就全然发生了变化。在付钱之际,用户提出要拥有绝对控制权,且必须亲自予以确认。对于更改账户信息这类操作,同样也得经由用户点头后才可以进行。

信任崩塌就在一瞬间

特别着重研究表明,信任这种事物被构建起来是较为缓慢的,然而将其毁坏却是极为迅速的。倘若AI在遭遇模糊选项之际,未进行询问便自行做出决定,那么用户会即刻产生不满情绪。

更让人觉得可怕的是,AI 悄然无声地偏离了原本规划定制的计划,要是用户并没有察觉到还好,可一旦被用户发现了,那 用户瞬间就再也没有信任感了。这种给用户带来的背叛感觉,要比直接出现错误还要难以去修复。

遇事不决别瞎蒙

搞苹果的团队察觉到,当人工智能处于不确定情形时,千万不要为了呈现出自动化的样子就随意去挑选一个,用户宁可它停下来去问个明白,也不希望它擅自作主胡乱猜测。

尤其是在那种有可能致使实际损失出现的场景当中,就像买错物件这种情况,AI的随机挑选会使得用户愤怒到暴跳如雷。而去停顿下来询问一声,反倒会显得比较可靠。

设计空间远未定型

苹果对9款主流AI智能体展开了研究,还对8位资深从业者进行了访谈,进而总结出了一套分析框架,该框架涵盖用户指令、活动可解释性、用户控制以及心智模型。

这表明当下的AI交互设计仍处于摸索时期,远未抵达定型阶段。各个方面都在试探着前行,用户到底能否接受,还得看谁更能够精准把握用户想法。

哪些AI智能体你曾使用过,有没有碰面过致使自己特别迫不及待想要狠砸电脑的时刻呢?欢迎于评论区去分享你的令人烦闷、闹心体验,点个夸赞以便让更多开发者能瞧见用户的真切心声。