新闻资讯

英伟达GTC 2026公布2026至2028年新版本路线图及相关计划

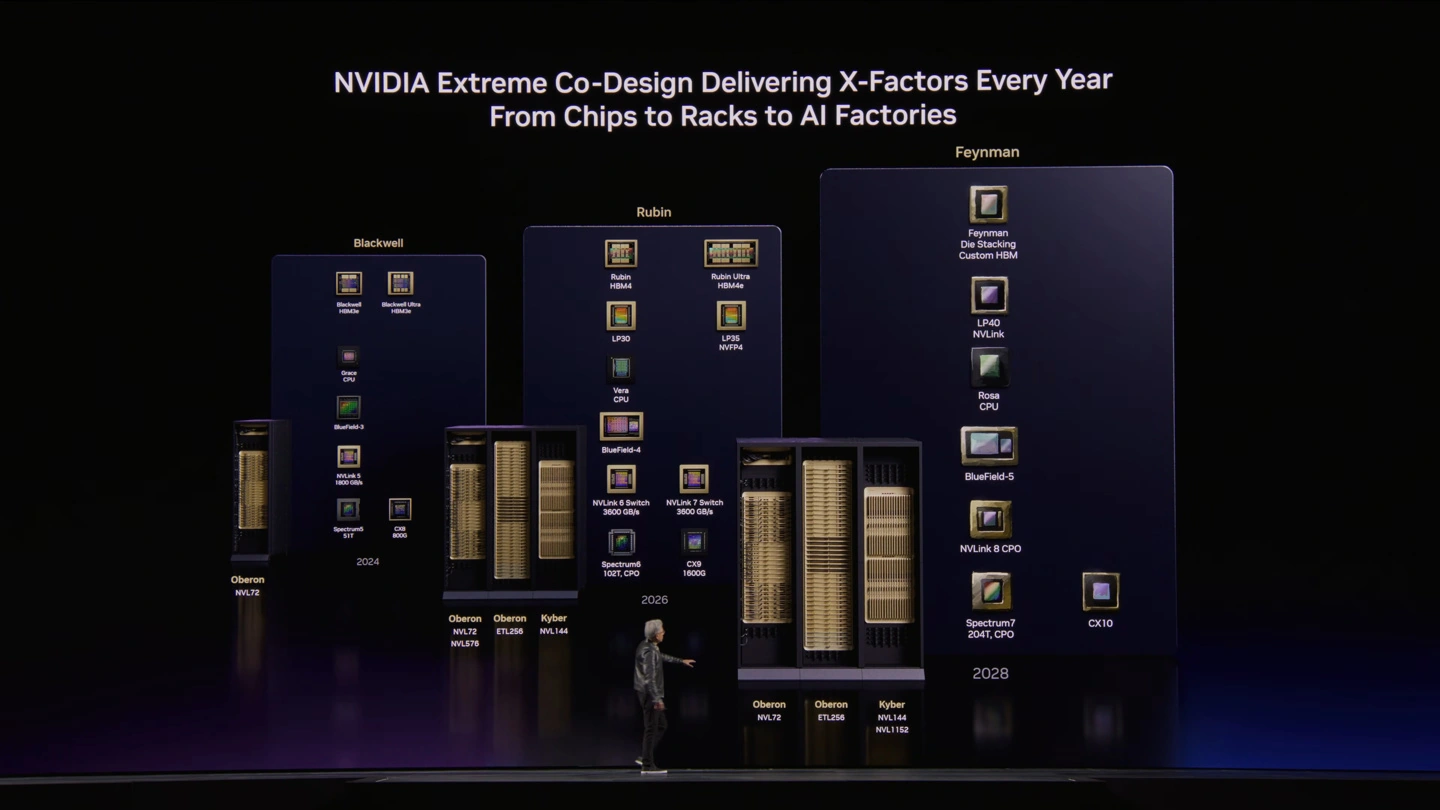

2026~系统的互联能力。就是最好例证。

英伟达在 GTC 2026 上所放出的这一轮路线图,直接将未来两年的算力底牌亮了出来,Rubin 和 Feynman 两代架构的细节首次被曝光,从 CPU 代号 Rosa 开始,到 3D 堆叠封装,再到光互联全面上机,每一处都指向一个事实,数据中心正在从“攒机”时代迈向“整机”工程时代。

两代架构定档 CPU与GPU走向紧耦合

Rubin世代会于2026到2027年展开,其配套的CPU正式被命名为Rosa,这是英伟达头一回明确自身GPU与CPU的世代绑定关联,Rosa并非单纯的主板搭档,而是专门针对Rubin GPU的NVLink互联以及内存一致性所设计的处理器,2028年接任的Feynman世代将会进一步缩短CPU与GPU的物理距离,从芯片布线层面消除传统CPU与加速器之间的协议转换瓶颈。

在系统集成度里头,这种紧耦合设计直接地体现出来。当下,Grace Hopper达成了CPU与GPU共用内存地址空间,Rosa以及后续的CPU会将这种模式转变为标准配置。对于超大规模的数据中心而言,这么一来,CPU可不只是负责调度与控制的配角了,而是跟GPU一同构建成一个完整的计算节点,把以往靠软件去弥补的硬件通信开销给降低了。

线性处理器单元路线明确 LP35瞄准2027年

Groq LPU身为英伟达于推理加速范畴的秘密武器,其路线图也一同被公开了。当下LP30已然被部署于部分云厂商的推理集群里,而新一代的LP35打算在2027年推出,时间点跟Rubin Ultra基本一致。 LP35会引入NVFP4数据格式,这是英伟达针对Transformer模型推理特意优化的低精度格式,能够在维持模型精度的状况下把显存带宽利用率再提升一个层次。

LP35过后,Feynman世代的LP40会支持更为激进的互联方案,依照GTC上的信息,LP40能够进一步强化与GPU加CPU系统的互联能力,它不再是单独部署的推理卡,而是变为整个机架内的一级计算单元,这般意味着未来的大模型推理或许不再会是“GPU算完再交付给LPU”,而是模型的不同层直接于GPU和LPU之间动态分配,达成流水线级的并行推理。

3D封装成标配 芯粒堆叠解决内存墙

英伟达予以正式确认,Feynman GPU是要采用芯粒堆叠的3D先进封装架构的。其根本不只是单一的纯芯片拼接,并非仅仅如此,而是要把那计算芯粒也垂直进行有效堆叠,同时还要把缓存芯粒以及I/O芯粒都垂直堆叠起来,如此这般就能极大程度地大幅缩短信号传输距离了。当前H100和B100已然在在用台积电的CoWoS技术,可话又说回来,Feynman的3D堆叠会进一步提升集成密度,进而把更多晶体管塞进有限的物理空间里。

一同与3D实现封装配套的是被定制化的HBM,英伟达不再是直接去采购标准的HBM颗粒,而是与存储厂商联合起来设计针对自家GPU架构以进行优化的HBM堆叠方案,这样的定制化能够调整HBM的逻辑层同控制电路,使得内存控制器跟计算芯粒之间的数据通路变得更短,延迟变得更低,对于万亿参数级别的大模型训练而言,这种从封装层面着手去解决内存带宽瓶颈的做法,比单纯增加HBM堆叠层数更加有效。

光互联打破铜线瓶颈 从横向扩展杀入纵向扩展

黄仁勋于GTC上清晰指明,光学互联的应用场景会从Scale - Out横向扩展延伸至Scale - Up纵向扩展。往昔光模块主要用以架与架之间的连接呵,然而英伟达正把光互联引入上架内部,也就是GPU与GPU之间、GPU与CPU之间的直连链路。CPO共封装光学技术是关键支撑,将光引擎与计算芯片封装一处呵,省却传统可插拔光模块的SerDes和信号重整环节。

采取支持CPO的思路而落地的产品是Quantum 8交换机,它在交换机ASIC周围直接封装了光学引擎,机架内部的铜缆被光纤所取代,这意味着单个机架内的GPU能够通过光学直连组成更大的逻辑集群,不再受铜缆传输距离以及带宽密度的限制,对于超大规模AI集群而言,机架内部的互联带宽将不再是瓶颈,Scale-Up的规模上限被极大地拉高。

定制化HBM成核心竞争力 供应链格局生变

英伟达于HBM采取定制化路线,此直接对存储供应链的游戏规则产生影响,传统HBM属标准产品,SK海力士、美光、三星予以统一规格颗粒,GPU厂商依据接口适配,然而英伟达如今要求存储厂商为其定制HBM的基础逻辑层,这表明存储厂商须开放更多设计权限且与英伟达的封装团队深度协同。

对于英伟达而言,这种定制化所带来的直接好处在于,能够依据不同代际GPU的架构特色,精准地匹配HBM的带宽,匹配其容量,匹配其功耗。针对Rubin和Feynman这两代产品来讲,定制HBM会成为区分不同SKU的关键变量。与此同时,这也表明英伟达对供应链的控制能力进一步得到增强,要是竞争对手不能获取同等规格的定制化存储,那么在系统级性能上面就会被拉开差距。

系统级工程成为护城河 单一芯片优势被稀释

从Rubin至Feynman那儿的路线图能看出,英伟达的核心壁垒已从单芯片性能转变为系统级工程能力了,3d封装、CPO光互联、定制化HBM、CPU跟GPU的紧耦合,这些技术单个拿出来都并非英伟达首先开创的,不过能将它们集成到一个可大规模量产的系统当中,当前唯有英伟达能够达成。

交付形式上直接呈现出这种系统级工程能力,未来英伟达AI系统或许不再是传统那种服务器主板加GPU插卡的样式,而是完整的机架级解决办法,数据中心所购置的并非零散的GPU和CPU,而是预先整合好了光互联、散热、供电以及软件栈的整柜系统,对于云厂商以及企业客户而言,这表明部署周期从几个月缩减到几周,运维复杂程度大幅度降低。

你认为,于英伟达这般将CPU、GPU、光互联、存储统统整合为完整系统的方案情形下,服务器厂商所拥有的议价空间究竟能有多大呢,云厂商的议价空间又究竟能有多大呢?欢迎于评论区把你的看法留存下来,点个赞以使更多从业者得以瞧见这场算力变革的全部面貌。