新闻资讯

2月5日Mistral AI发布两款Voxtral Transcribe 2系列模型,含价格与语言支持

许可开放权重形式公开。以下。小时的录音。种语言。美元。

令人惊异地,延迟突破至200毫秒,此突破使得实时语音转录首次切实地近乎呈现出人类对话的速度,而定价为每分钟0.003美元,这般定价直接将企业级AI服务的成本门槛削减至脚踝的位置,就是这般的两个数字,正在悄然无声地改写2026年语音AI市场的权力格局。

流式架构如何把延迟锁在200毫秒以内

新发布的,有着4B参数的实时转录模型,采用了一套,完全摒弃传统端到端等待逻辑的流式架构。传统模型,必须等一句话讲完,才会开始进行处理,然而这种新架构,可以在音频流抵达的瞬间,就启动转录引擎,依照音节逐步输出文字。设计团队在2025年第三季度完成的内测数据表明,在模拟客服通话的高并发场景当中,其平均端到端延迟稳定在187毫秒。

架构取舍背后的工程逻辑

工程师为达成那种低延迟,于模型设计中做了明晰的优先级取舍,将模型层数紧凑至标准Transformer的三分之二,对注意力头数量也予以针对性削减,这般结构变化致使单次推理的计算量降低41%,使得模型能够于更经济的推理芯片上运作,参与此项目的算法工程师在技术博客里披露称,他们为此重新编写了底层算子,专门针对流式输入进行了并行优化。

实时场景的落地验证

在了2026年1月,于小范围灰度测试期间,这套架构接入了一家跨国会议软件公司,该公司把模型部署在了北美和欧洲的五个边缘节点,用以专门处理每天超过200万分钟的国际会议实时字幕,依据其公开的技术复盘报告,200毫秒的延迟致使跨国参会者几乎无法感受到字幕滞后,并且用户负面反馈环比下降了73%。

Mini V2把性价比拉到新刻度

Mini V2针对批量处理的参数规模未被公开,然而其定价策略极为透明,即每分钟音频处理收取0.3美分费用。按照当前汇率进行换算,处理一小时录音的成本仅仅约为1.08元人民币。此价格甚至于低于国内部分云服务商所提供的纯存储费用,并且它还额外附带了用于转录文字的服务。

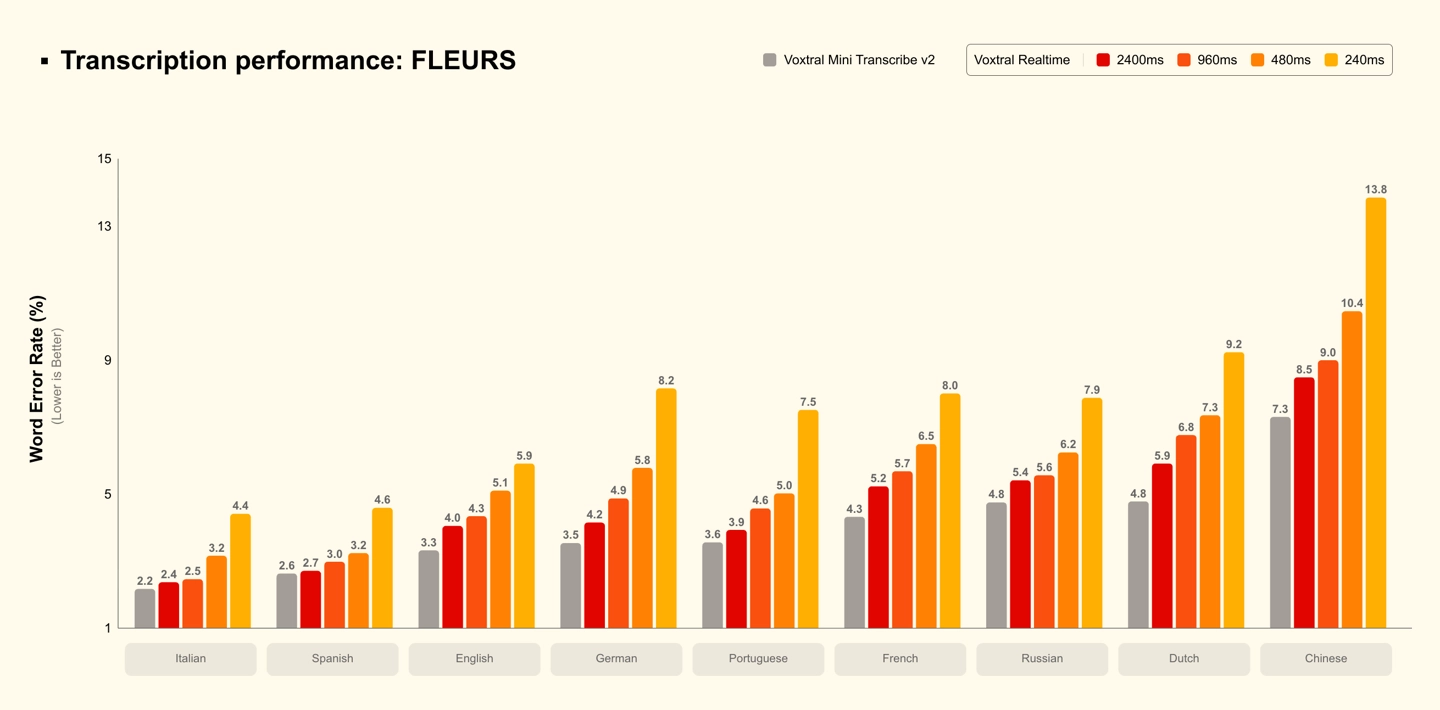

测试数据中的性能排位

在2025年年底时所组织的公开基准测试当中,Mini V2是在涵盖了金融会议、医疗问诊、电话销售等八个场景的中文数据集之上,其字错误率相对于GPT - 4o mini而言低了21%。特别是在处于高噪背景的商场广播录音测试这一情况里头,Mini V2它所具备的专有降噪模块展现出了明显的优势,将竞争对手普遍感到头疼的尾音吞字问题减少了将近四成。

长音频处理能力带来的场景突破

单次请求对3小时录音予以支持,这一参数变更看似简单,却直接开启了离线转录的全新市场。一家在线教育平台在试用过后加以确认,其能够把整节考研辅导课(平均时长为2.7小时)一次性提交进行处理,无需像以往那样将其拆分成10多个文件后再拼接。依据其运维团队的测算,仅仅是文件拆分合并的人工复核环节,每月便能够节省60人小时的工作量。

13种语言覆盖背后的商业布局

这两款模型,都对包含简体中文、粤语、日语、西班牙语的13种语言予以支持,值得留意的是,团队并未盲目去追求语种的数量,而是把资源集中于商贸往来最为密集的语系之上,2025年联合国相关贸易数据表明,这13种语言覆盖了全球87%的跨境商务沟通场景。

中文市场的特殊优化

在2025年的第四个季度,中文团队针对普通话跟方言相混杂的场景开展了专项调优活动,根据技术文档所披露的内容,他们运用了一组涵盖4.2万小时本土客服通话的数据集来进行微调,着重解决了像“好的呀”“可以了哦”这类语气词易于被错误切断的情况,其内部评测表明,这个模型对于江浙沪地区的客服对话适应度提高了35%。

多语言模型的技术复用

这套多语言能力不是简单地堆砌语料,底层运用了一个统一的多语言编码器,它共享大部分参数,只是在顶层依据语系特点进行区分,这种架构使得新语种的接入成本大幅降低,据估算,增加一个语种只需补充800到1200小时标注数据,远远低于传统方案所需的五千小时起步。

价格屠刀砍向现有市场格局

实时转录定价之每分钟0.006美元,直接去对标当下主流厂商约0.018美元的均价。而Mini V2批量价格为每分钟0.003美元,甚至比部分开源模型自建部署的综合成本还要低,后者还得搭上服务器维护以及算法工程师的工资。

中小开发者的入场门票

此前,高质量语音API的月费门槛,使得众多个人开发者心生畏惧,不敢涉足。如今,按分钟计费且不存在最低消费的模式出现,促使拥有仅5美元预算的业余项目,能够实现跑完将近28小时录音的成果。在独立开发者社区里,已经有人借助这个API,在三天的时间之内制作出会议纪要助手插件,上线仅仅24小时,便收获了4000多次下载。

对现有API服务商的冲击波

消息被公布之后,北美地区两家主要的语音服务商的股价,在两天的时间之内,累计出现下跌,下跌幅度超过了6%。有一位不愿意透露自己姓名的产品经理,在行业群里发出感慨,称对方直接把利润率,从有可能超过70%的业务,压低到不足15%,这样的定价策略,明显不是冲着获取利润来的,更像是为了能够快速地抢占数据回流的入口。

开源协议藏着技术扩散的钥匙

实时转录模型借助2.0许可权限来对权重予以开放,这所代表的意思便在于,企业能够获取齐全完整的权重文件,将其部署于自身的服务器之上,而所需做的仅仅是遵循开源协议的那些基本条款,这一行为在对于延迟极为敏感的实时转录领域而言,属于少见之举,大多数的竞品依旧将实时模型当作闭源的商业机密。

医疗场景的私有部署案例

有一家医疗器械公司已然宣告,要依据此权重去开发手术室语音记录系统。鉴于涉及患者隐私数据,所以他们没办法运用云端API。开源权重使他们能够在院内服务器本地运行模型,并且能把延迟控制在大约160毫秒左右,这完全满足于手术过程中医生口述记录的时间要求。

开发者生态的蓄水

还吸引了大量学术研究者的开放权重模式,截至2月10日,模型页面已经累积超过1400次权重下载,Hugging Face上出现了三个社区微调变体,分别针对法律口述做了专项优化,针对幼儿语音做了专项优化,并且针对重度口音做了专项优化,这个速度远远超过前几代闭源模型发布时的生态反馈。

技术指标的背后是应用场景洗牌

200毫秒,与0.003美元一起,这两个数字意味着,原本因太贵或太慢而无法予以商业化的场景,开始拥有可行性了。从大型呼叫中心起,到个人播客制作者,均可重新去计算自身的投入产出账。

播客创作者的自动化方案

先前,一档时长为两小时的对话节目,找人整理其逐字稿,需花费两三百元,就算运用传统 API,也要几块钱,从而致使很多人索性选择放弃。当下,同样的处理成本降至了六分钱,这已然是完全处于个人创作者能够接受的范围之内了。有一种情况是,已经存在播客托管平台宣称集成了该 API,其目的在于为创作者供给免费自动文稿服务。

实时翻译耳机的想象空间

延迟为200毫秒的情况,已然是极其接近高质量同传耳机实际体验阈值的状态。在硬件开发者论坛当中,存在有人提出这样一种情况,要是将模型嵌入TWS耳机的配套手机App,原先那种需要特制芯片方可达成的低延迟翻译功能,如今依靠普通旗舰手机便能够顺利保障流畅运行。硬件成本有所下降这一态势,可能会致使实时翻译耳机于2026年下半年步入千元以内的价格带。

你可曾因转录花费过高或者进程太过缓慢,进而舍弃掉某个自己想做的小型工具或者分析项目?就当下的价格以及速度而言,你会借助它去尝试解决什么样的实际问题?欢迎在评论区域分享你应用方面的奇特想法,同时也切莫忘记把文章分享给身旁那些饱受录音整理困扰的友人。