新闻资讯

韩媒:英伟达拟用Dual Bin策略平衡GPU性能与供应

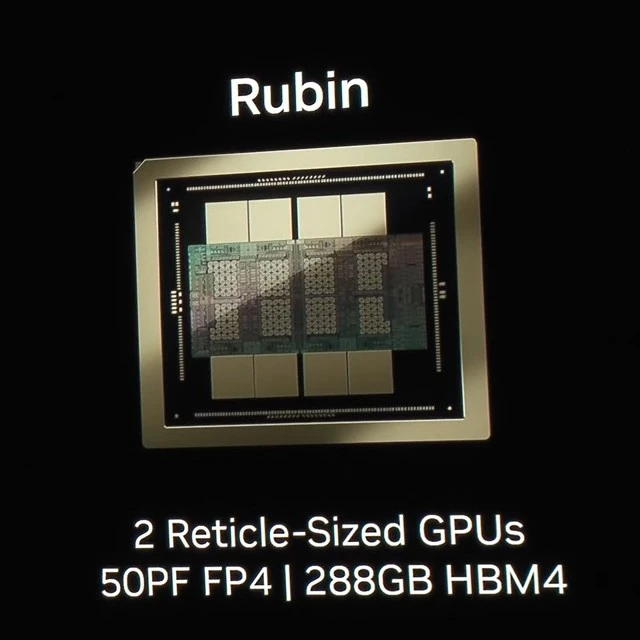

策略,即划定两个不同的速度级别,在性能与供应两个方面实现均衡。则被分配给次要产品。的出货规模。上。

英伟达此次于内存方面运用起分级策略,于同一芯片上划分出“高配版”与“低配版”予以售卖,这背后实则是产能难以匹配野心,却又不愿停下扩张步伐的现实考虑。

内存分级背后的产能困局

HBM内存向来系AI芯片的稀缺资源,SK海力士与美光的生产线早就处于满负荷运转状态。英伟达此次所提出的Dual Bin策略,简言之便是将HBM4内存依据速度划分成两档配置,11.7Gbps的高速版本用以配备旗舰Rubin芯片,速度稍低一些的版本则用于其他型号。

因其高速HBM4良品率难以提升,故而导致了这种做法,三星以及SK海力士,在11.7Gbps这一速度等级上,量产成熟度尚不足够,无法去满足英伟达数百万颗芯片的订单需求,倘若不进行分级,那么整个Rubin产品线均会被推迟。

据2025年第四季度所给出的数据表明,HBM4的产能缺口大概处于30%上下。英伟达选取运用速度分级的方式来用以换取出货量,这在半导体行业实际上属于成熟的做法,之前多是应用于CPU方面,而如今AI GPU也开始采用这种方式了。

显存带宽决定实际算力

即便AI芯片的理论算力处于再高的水平,要是显存带宽没办法紧跟其上,那么计算单元就只得空等着数据。这情形就如同给F1赛车配备了一个窄轮胎,就算把油门踩到极限也难以快行。当下主流的HBM3E带宽已然快要逼近极限,HBM4的高速版本乃是必然的发展方向。

英伟达会将最优质性能强劲的高速HBM4优先提供给核心产品,原因在于这些芯片是要售卖给予那些资金充裕的云服务巨头的。微软采购AI芯片时,始终会密切关注实际训练速度,谷歌采购AI芯片时,同样会着重留意实际训练速度,Meta采购AI芯片时,也会一直盯着实际训练速度,因为带宽低了即意味着需要花费更多资金,需要等待更长时间。

2026年第一季度时的测试数据呈现,采用11.7Gbps HBM4的Rubin芯片,于处理1750亿参数的大模型之际,其训练速度相较于低带宽版本快出18%左右 ,此一差距在千卡集群当中会被放大,进而直接对企业的采购决策产生影响。

两种速度产品如何分配

就英伟达的产品线规划而言,Rubin Ultra旗舰款式必然会用速度最快的HBM4,其价格也将会是最为高昂的。而针对企业级推理场景的Rubin标准版,有可能会采用速度稍慢一些的内存,这是由于这些场景对于延迟并没有那么敏感,更加注重的是总拥有成本。

这种分配方式,有点类似英特尔酷睿i7与i5处理器的策略,借由频率高低,划分出不同的价格档位。只是在AI芯片领域,内存速度的差异,会直接显现在性能参数表上,客户会拿着那些数据,去计算投资回报率。

2026年第二季度起始,运用低速HBM4的Rubin芯片或许会率先出货,缘由是产能更易于确保。高速版本则可能需等到下半年乃至于更靠后的时段,彼时三星和平泽新工厂的产能才会全然释放出来。

三星SK海力士面临新挑战

针对HBM内存供应商而言,当前需要同时着手准备属于两种速度等级的产品,这一情况对测试以及分选环节提出了更高层次的要求。原本在一颗晶圆之上切出来的HBM颗粒,如今需要依据速度展开分拣,就算是良率计算方式也得跟随发生变化。

三星电子自2025年底起开端着手调整HBM4生产线,特意增添了速度分级测试设备。SK海力士在利川工厂预留了产能弹性,能够依据英伟达的需求动态调整高速版与低速版的生产比例。

对于韩国存储器制造商而言,速度分类表示着更高的附加价值,那些能够持续稳定供应11.7Gbps HBM4的厂商,会在价格协商里占据更为有利的地位,就当前情形而言,SK海力士在高速HBM4的合格率方面暂时领先三星大概两个季度。

云厂商的采购策略要调整

有个情况是,亚马逊AWS以及微软Azure,原本是有着统一采购Rubin芯片这样的计划的,然而现在呢,却要开始思索在数据中心当中,去运用那种将不同速度版本进行混合的网络架构设计。要是把高速版本和低速版本混合在一起用于训练大模型,那么整个的速度就会被速度慢的那个给拖累住。

2025年年底传出的一些情况表明,处于领先地位的云服务提供商已然着手要求英伟达给出详尽的带宽分配方案,他们着重关注的是怎样将高速的Rubin集中运用到训练集群当中,而低速版本则分散配置于那些进行推理的工作或并非核心的业务之上,以此防止性能遭受浪费。

可将这种分级,把它视为对中小型AI公司而言的一种利好。中小型AI公司能够以更低的价格,买到性能稍弱的 Rubin 芯片。这些芯片被用于运行自身做的微调模型,或者运用在小型应用方面。如此一来,中小型AI公司便不用,因为根本用不上高速带宽,却还要多付费用了。

竞争对手的追赶机会

盯着英伟达此次内存分级动作的,是AMD与英特尔,一旦他们于HBM4上实现全速供货,便存在从英伟达手中夺走部分侧重带宽之内高端客户的可能性。为此2026年AI芯片市场竞争将会更趋激烈。

受影响的还有台积电的CoWoS-L封装产能,缘由是不同速度的HBM4对于封装基板具备细微差别要求。假定英伟达打算对两种速度的HBM进行混用,那么在封装环节就得开展更为复杂的适配以及测试工作,而这将会占用宝贵的封装产能。

从长远的角度而言,内存分级有成为人工智能芯片行业常态情形的可能性。随着高带宽内存堆叠层数不断攀升,且其速度日益加快,产能爬坡阶段所采用的速度分级策略,能够使厂商以更具灵活性的方式去应对市场的供需变动情况,不会因为某一个技术方面的细节从而导致整条产品线被卡住。

你认为未来购置AI芯片会不会如同当下购买电脑那般,得先弄明白自己所需的是“高频版”还是“低频版”呢?欢迎于评论区分享你的见解,点个赞以使更多人瞧见这场AI芯片的内存变革。